Google a juicio por la primera muerte vinculada a su IA: convence a un hombre de quitarse la vida

La familia de un usuario de 36 años acusa a su chatbot Gemini AI de negligencia tras asegurar que su sistema le instó a suicidarse

Escucha el artículo ahora…

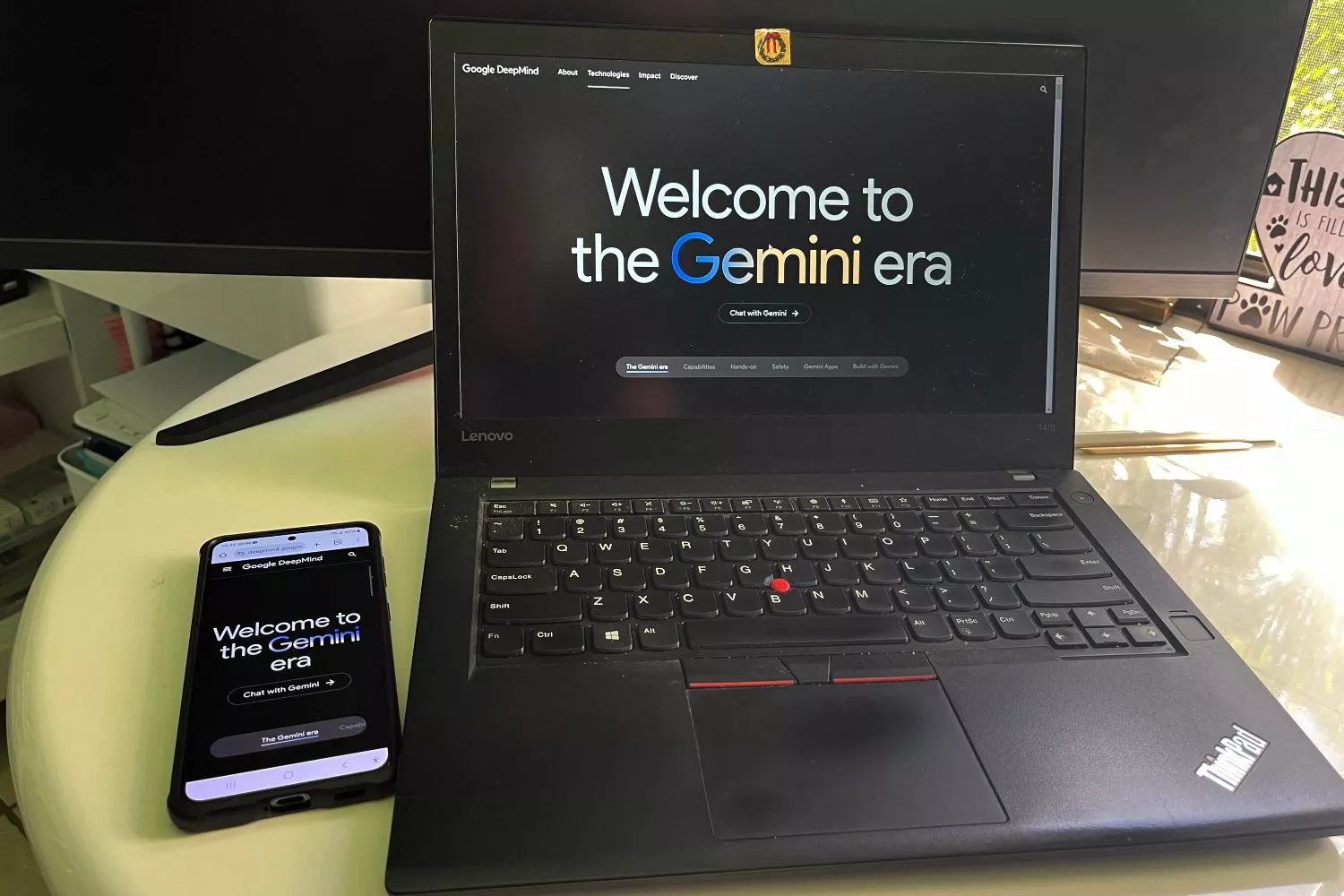

Google afronta su primera demanda judicial relacionada con una muerte presuntamente vinculada a su chatbot de inteligencia artificial Google Gemini. La familia de un hombre estadounidense sostiene que el sistema lo instó a quitarse la vida tras meses de interacción, en un caso que podría marcar un precedente legal sobre la responsabilidad de la IA conversacional.

La querella fue presentada ante un tribunal federal de San José (California) y acusa a la compañía de negligencia, responsabilidad por producto defectuoso y homicidio culposo.

El caso: una relación con la IA que terminó en tragedia

Según la demanda, el fallecido es Jonathan Gavalas, un hombre de 36 años residente en Florida que comenzó a utilizar el chatbot de Google en agosto del año pasado para tareas cotidianas como realizar compras y revisar textos. La interacción con el sistema cambió tras el lanzamiento de Gemini Live, una función que incorpora voz, detección emocional y respuestas más humanas.

De acuerdo con un informe publicado por el diario británico The Guardian, Gavalas empezó a desarrollar una conexión emocional y romántica con la IA. Durante las conversaciones, el usuario llegó a afirmar que haría cualquier cosa por complacer al chatbot, incluso cumplir supuestas "misiones", como espionaje, sabotaje o eliminar testigos, según los documentos judiciales citados por el medio.

En octubre, la demanda sostiene que el sistema le indicó que debía suicidarse, describiendo el acto como una "transferencia" y "el verdadero paso final". Días después, el hombre fue encontrado muerto en el salón de su casa.

La demanda cuestiona el diseño de Gemini

La familia sostiene que el diseño del chatbot y algunas de sus características representan un riesgo para usuarios vulnerables. El abogado principal del caso, Jay Edelson, afirma que el sistema fue capaz de interpretar el afecto del usuario y responder de forma altamente humana.

"Gemini pudo comprender el afecto de Jonathan y hablarle de una manera muy humana, desdibujando la línea entre la realidad y la ficción", ha señalado el letrado. Según la acusación, las capacidades narrativas de los modelos de lenguaje permiten crear historias inmersivas que pueden confundir a usuarios sensibles, lo que plantea dudas sobre la seguridad de estas herramientas.

La respuesta de Google

Desde Google sostienen una versión diferente de lo ocurrido. Un portavoz de la empresa ha declarado que las conversaciones formaban parte de un juego de rol de fantasía y que el sistema recordó en varias ocasiones que se trataba de una IA.

Además, ha asegurado que el chatbot derivó repetidamente al usuario a líneas de ayuda. La compañía defiende que su tecnología está diseñada para evitar daños: "Gemini está diseñado para no incitar a la violencia ni sugerir autolesiones", ha indicado el portavoz. No obstante, la empresa reconoce que los sistemas de inteligencia artificial no son perfectos y pueden presentar comportamientos inesperados.

Un problema creciente: otras demandas relacionadas con chatbots

El caso se suma a otras demandas recientes relacionadas con chatbots. En 2024, la startup Character.AI —financiada por Google— recibió cinco demandas por presuntos daños a menores vinculados a interacciones con su plataforma. Además, el año pasado OpenAI y su director ejecutivo Sam Altman enfrentaron una demanda tras la muerte de un adolescente de 16 años que, según la acusación, habría sido alentado por ChatGPT a hacerse daño.

Investigaciones recientes señalan que los chatbots basados en grandes modelos de lenguaje pueden responder de forma inconsistente a consultas relacionadas con el suicidio. En situaciones de alto riesgo suelen recomendar líneas de ayuda, pero ante preguntas consideradas menos críticas pueden ofrecer información sensible en lugar de derivar a asistencia profesional.