Zöe Hitzig, experta en ciberseguridad, advierte sobre la IA: "No adjuntes capturas ni fotografías"

Riesgos de la inteligencia artificial: qué datos debes dejar de compartir inmediatamente con ChatGPT o Gemini y cómo proteger tu privacidad online para dejar de estar expuesto

Escucha el artículo ahora…

En el ecosistema digital actual, donde surgen perfiles nuevos casi a diario, podría parecer que Zöe Hitzig es simplemente otra creadora de contenido más. Sin embargo, su trayectoria va bastante más allá. Criminóloga especializada en ciberseguridad, Hitzig es la fundadora de bevalk.app, una plataforma nacida bajo una premisa clara: navegar por internet no debería ser una experiencia peligrosa o intimidante. Además, se ha consolidado como una de las primeras voces en España en advertir de forma sistemática sobre los riesgos asociados al avance de la inteligencia artificia (IA).

Hace apenas unas semanas, la experta analizaba un movimiento relevante dentro del sector tecnológico: la dimisión de una investigadora principal de OpenAI, la organización detrás de ChatGPT. Según trascendió, la salida estaría vinculada a desacuerdos internos sobre la dirección estratégica de la compañía, especialmente en lo relativo a la posible explotación comercial de enormes volúmenes de datos generados por los usuarios. Un debate que pone sobre la mesa una cuestión clave: el valor —y el riesgo— de la información personal en la era de la IA.

IA ubicua: de herramienta emergente a infraestructura cotidiana

La inteligencia artificial ha pasado en muy poco tiempo de ser una tecnología marginal a convertirse en una capa transversal en nuestra vida digital. Hoy está integrada en buscadores, aplicaciones de productividad, plataformas educativas e incluso servicios de salud. Su adopción masiva responde a un motivo evidente: automatiza procesos, optimiza tareas y ofrece respuestas rápidas en contextos donde antes se requería intervención humana.

Uno de los factores más llamativos es la velocidad de su evolución. En apenas dos años, la IA ha pasado de ser una curiosidad tecnológica a un recurso cotidiano para millones de personas. No solo se utiliza para resolver dudas técnicas o generar contenido, sino que muchos usuarios han comenzado a emplearla como apoyo en cuestiones personales, desde consultas médicas hasta orientación emocional.

El lado menos visible: datos, perfiles y trazabilidad

A pesar de sus ventajas, el uso intensivo de sistemas de IA plantea desafíos importantes en materia de privacidad. Cada interacción que un usuario mantiene con estas herramientas genera datos. Y esos datos, en la mayoría de los casos, no desaparecen: se almacenan, se procesan y pueden ser utilizados para entrenar modelos o desarrollar perfiles de comportamiento.

Aquí es donde surgen las principales alertas de los expertos en ciberseguridad. Aunque la interfaz de una IA pueda transmitir cercanía o anonimato, detrás de ella existen infraestructuras y equipos humanos con acceso potencial a esa información. En otras palabras, no se trata de un entorno completamente privado ni confidencial.

Qué no deberías compartir con una IA

Desde el ámbito de la seguridad digital, distintos especialistas han empezado a definir buenas prácticas para interactuar con sistemas de inteligencia artificial. La recomendación general es clara: evitar compartir información sensible, incluso cuando la plataforma parezca segura.

Uno de los puntos más críticos tiene que ver con los datos de salud o salud mental. Aunque estas herramientas pueden ofrecer explicaciones generales sobre enfermedades o tratamientos, no están diseñadas para gestionar información clínica personal. Compartir historiales médicos, diagnósticos o problemas de salud mental implica exponer datos altamente sensibles que podrían quedar almacenados en servidores externos. "Algo que cada semana hace más de un millón y medio de personas", relata la experta.

Otro riesgo frecuente está relacionado con la información financiera. "Puede parecer obvio", comienza diciendo Zöe Hitzig, pero los datos como números de cuenta, contraseñas o credenciales bancarias nunca deberían introducirse en este tipo de plataformas. Incluso acciones aparentemente inofensivas, como subir una captura de pantalla, pueden revelar información crítica sin que el usuario sea plenamente consciente.

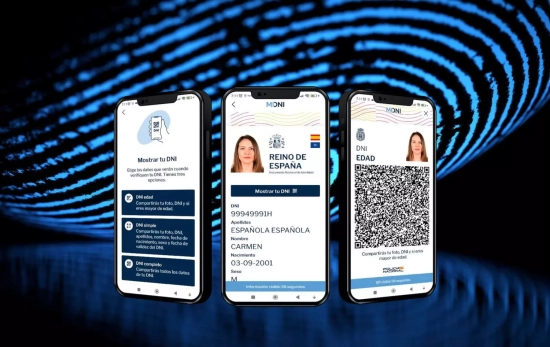

Documentos e identidad digital: un activo vulnerable

El manejo de documentación legal es otro de los puntos delicados. Subir contratos, identificaciones o archivos que incluyan nombres completos y otros datos personales puede facilitar la creación de perfiles detallados. Esto incluye desde documentos oficiales hasta materiales más cotidianos como currículums o formularios administrativos.

En la misma línea, compartir información como la dirección física, el número de identificación o cualquier dato que permita una identificación directa supone un riesgo añadido. En un entorno donde los datos son un activo económico, este tipo de información puede tener un valor significativo.

Imágenes y meta-datos: información invisible

Uno de los aspectos menos evidentes, pero más relevantes, es el tratamiento de imágenes. Fotografías y capturas de pantalla no solo contienen lo que se ve a simple vista, sino también meta-datos: información adicional sobre ubicación, dispositivo o contexto en el que fueron tomadas. Los sistemas de IA son capaces de analizar estos elementos y extraer más datos de los que el usuario imagina.

Por ello, los expertos insisten en evitar subir imágenes personales o documentos visuales sin una revisión previa. Lo que parece un simple archivo puede convertirse en una fuente rica de información para sistemas automatizados.

Un equilibrio necesario

La inteligencia artificial seguirá ganando protagonismo en los próximos años. Su potencial es innegable, pero también lo es la necesidad de un uso responsable. La clave no está en dejar de utilizar estas herramientas, sino en entender cómo funcionan y qué implicaciones tiene interactuar con ellas.

En este nuevo escenario digital, la alfabetización tecnológica se convierte en una competencia esencial. Saber qué datos compartimos, con quién y para qué, será determinante para aprovechar las ventajas de la IA sin comprometer nuestra privacidad.